Um novo sistema de inteligência artificial desenvolvido pelo Google pode decidir quando confiar em decisões baseadas em IA sobre diagnósticos médicos e quando consultar um médico humano para uma segunda opinião.

O sistema chamado Complementarity-driven Deferral-to-Clinical Workflow (CoDoC), funciona ajudando a IA preditiva a saber quando não sabe algo – evitando problemas com as mais recentes ferramentas de AI que podem inventar informações quando não têm respostas confiáveis. Seus criadores afirmam que ele pode melhorar a eficiência na análise de dados de exames médicos, reduzindo a carga de trabalho em 66%, mantendo a precisão – mas ainda não foi testado em um ambiente clínico real.

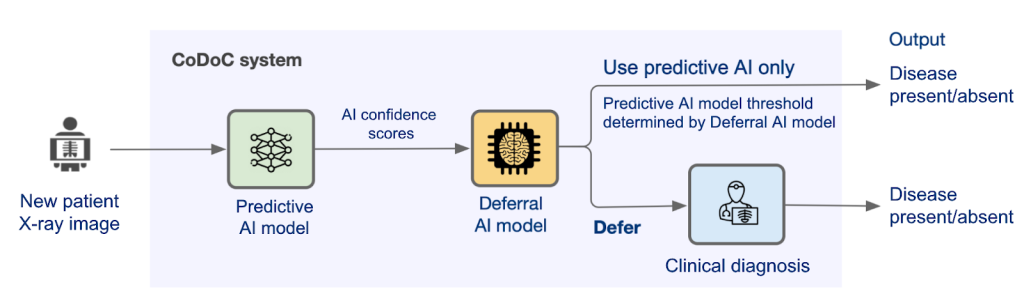

Ele foi projetado para trabalhar junto com os sistemas de AI existentes, que são frequentemente usados para interpretar imagens médicas, como radiografias de tórax ou mamografias. Por exemplo, se uma ferramenta de AI preditiva estiver analisando uma mamografia, o CoDoC julgará se a confiança percebida da ferramenta é forte o suficiente para confiar em um diagnóstico ou se é necessário envolver um médico se houver incerteza.

CoDoC aprende a estabelecer a precisão relativa do modelo de IA preditiva em comparação com a interpretação dos médicos e como essa relação flutua com os escores de confiança da IA preditiva.

Uma vez treinado, o CoDoC pode ser inserido em um fluxo clínico hipotético futuro envolvendo tanto uma IA quanto um médico. Quando uma nova imagem de paciente é avaliada pelo modelo de IA preditiva, seu escore de confiança associado é alimentado no sistema. Em seguida, o CoDoC avalia se aceitar a decisão da IA ou recorrer a um médico resultará em uma interpretação mais precisa.

Veja no exemplo abaixo:

Em um teste teórico do sistema realizado pelos desenvolvedores na pesquisa do Google e no Google DeepMind, o laboratório de AI do Reino Unido que a gigante tecnológica adquiriu em 2014, o CoDoC reduziu em 25% o número de interpretações de mamografias com resultados falsos positivos.

O sistema de AI CoDoC do Google mostra promessa em auxiliar os diagnósticos médicos, determinando quando confiar em decisões baseadas em AI. Ele demonstrou a capacidade de reduzir interpretações falsamente positivas de mamografias e aprimorar a precisão diagnóstica. No entanto, são necessários testes adicionais em ambientes clínicos reais para avaliar completamente sua eficácia.

Fontes: https://www.newscientist.com/article/2382756-google-ai-helps-doctors-decide-whether-to-trust-diagnoses-made-by-ai/

https://www.deepmind.com/blog/codoc-developing-reliable-ai-tools-for-healthcare

Imagens: DeepMind